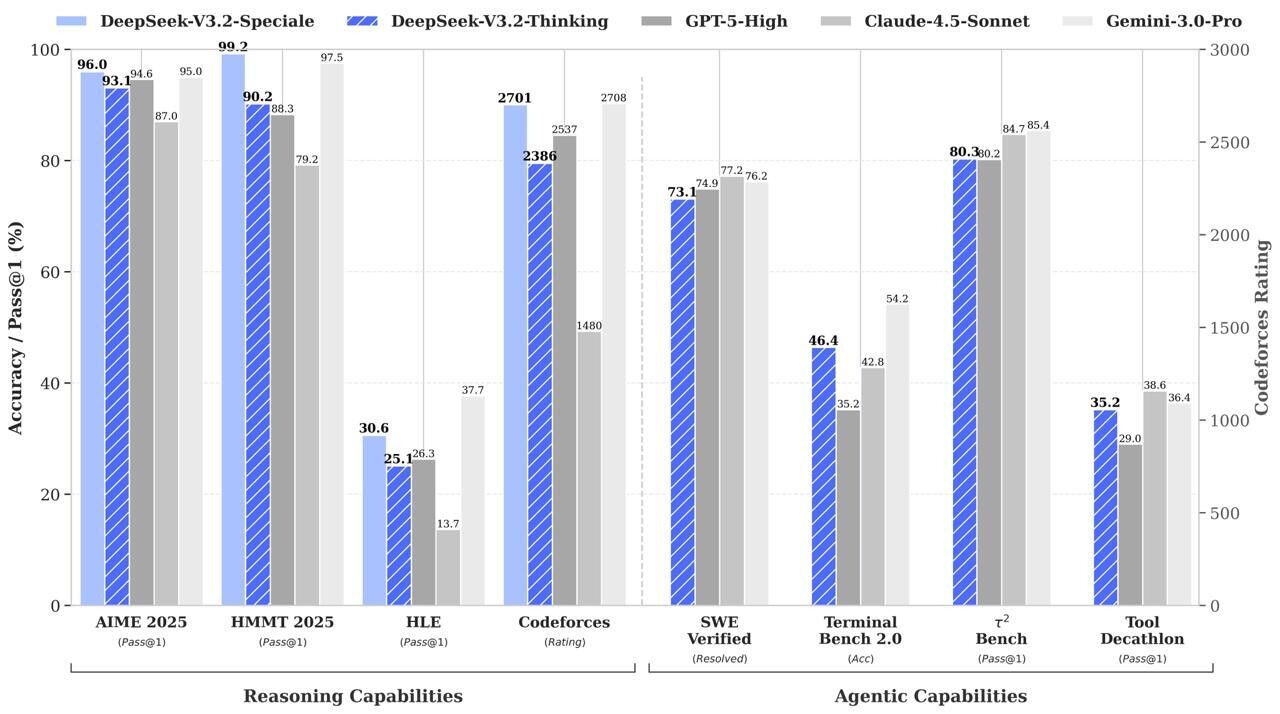

Результаты моделей в тестах. Источник: DeepSeek

Компания представила две версии, оптимизированные для агентных задач: DeepSeek-V3.2 и DeepSeek-V3.2 Speciale. Первую добавили в бесплатный чат-бот стартапа в веб-версии и мобильных приложениях.

Разработчики заявляют, что DeepSeek-V3.2 в бенчмарках показывает себя на уровне предпоследней модели OpenAI GPT-5 (high).

V3.2 Speciale «обходит» Gemini 3 Pro (preview) в математике. Она также решила наборы задач из международных олимпиад по математике (IMO), программированию (ICPC World Finals) и информатике (IOI), заявляет DeepSeek.

DeepSeek-V3.2 Speciale в чат не добавили, она доступна в API. Веса моделей также выложили Hugging Face: DeepSeek-V3.2 и DeepSeek-V3.2 Speciale, у обеих на 685 млрд параметров.

Источник: https://vc.ru/ai/2626199-deepseek-v32-novye-modeli-olimpiady